本篇随笔涉及 IT 行业、消费品市场、人文与社会等。

The jottings refer to IT industry, consumer markets, culture & society.

1. IT 行业 / IT industry

1.1. 大型语言模型 / Large Language Model (LLM)

由 OpenAI 公司开发的基于大型语言模型(LLM)GPT-3.5 的对话(应答)机器人 ChatGPT 于 2022 年底发布,迅速引起了各界关注,使各 IT 企业终于摆脱了需要寄望于「元宇宙」概念维持利润预期的困境。2023 年 3 月发布的 GPT-4 在智能程度上又有了显著提升。在对主创团队的采访中,多人均表示未料到 ChatGPT 会产生如此程度的影响以及值得如此程度的关注,可见其中存在着其他领域的助推。

GPT 系列模型可被认为是具有海量知识储备的、基于文字作简单逻辑推理和演绎的语言模型。Stephen Wolfram 在一篇长文「What Is ChatGPT Doing … and Why Does It Work?」(英文原文,依赖 ChatGPT Plus 做的中文译文)中详细解释了它的原理,并提到:

With ChatGPT, we’ve got an important new piece of information: we know that a pure, artificial neural network with about as many connections as brains have neurons is capable of doing a surprisingly good job of generating human language.

有了ChatGPT,我们获得了重要的新信息:我们知道一个拥有与大脑神经元数量相当的连接数的纯人工神经网络能够惊人地生成人类语言。

Stephen Wolfram

文中还进一步作了猜想:

My strong suspicion is that the success of ChatGPT implicitly reveals an important “scientific” fact: that there’s actually a lot more structure and simplicity to meaningful human language than we ever knew—and that in the end there may be even fairly simple rules that describe how such language can be put together.

我强烈怀疑,ChatGPT 的成功暗示了一个重要的“科学”事实:有意义的人类语言实际上比我们所知道的要简单得多,最终可能会有相当简单的规则描述语言是如何组织的。

Stephen Wolfram

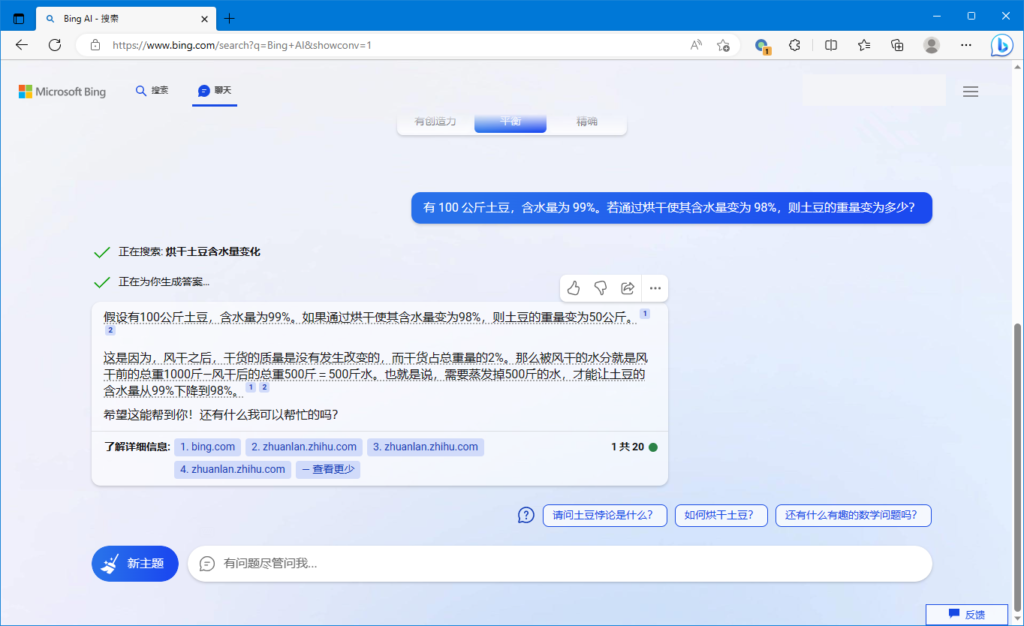

公众在使用中多关注 ChatGPT 的回答在多大程度上类人,或达到人类中的何种水平。在对社科类问题的响应中,它的应答多不具有深度,可能存在逻辑混乱;对于文学类的要求,它的应答则不易为人类所分辨(这也可能是因为文学评价标准的多元或混乱)。在理工科领域,「二次元的中科院物理所」用一套考研题作了测试,认为它对于专门学科「理解相当深入、解题思路清晰准确,但计算能力较差」。关于它的逻辑推理能力,另有一个反直觉的测试作为验证,而通过在 New Bing 中使用同一问题测试所给出的参考资料(链接2:知乎,2021-12-27;链接3:知乎,2015-07-18;链接4:知乎,2021-07-05,内容无关),可以认为此类模型的推理可能还是要基于互联网内容。

Yann Lecun 则认为 ChatGPT 不具有重大创新,LLM 也不是通用人工智能的正确方向。「冷哲」对此作了阐释,指出:此类模型仍在采用归纳的方法,而无法实现可靠的演绎;ChatGPT 带来的不是质的飞跃,而是量的改变(使用了超级计算机)。

1.2. 人工智能艺术 / Artificial intelligence art

除了大型语言模型(LLM),生成式人工智能(generative artificial intelligence)在诸多艺术领域也在不断进步。特别是在绘画方面,已有使用 AI 模型进行创作并获得人类所设奖项的事件发生(2022 年 8 月,数字艺术类奖项;2023 年 4 月,摄影类奖项),该领域知名的模型/应用包括 2022 年 4 月 OpenAI 发布的 DALL-E 2(商业)、2022 年 7 月 Midjourney 发布的同名应用(商业)、2022 年 8 月发布的 Stable Diffusion(开源)。而这些模型的快速进步也使得其对部分行业从业者的替代变得似乎近在咫尺。

AI 艺术的成果引发了有关知识产权的争议,但个人认为,AI 艺术可以被看作对风格的模仿而非对内容的抄袭,且从长远来看,生成式 AI 的发展和应用很可能导致知识产权概念及其保护范围的变化。以图像生成类 AI 为例,将来的画师可能会由原来生产一幅或一系列具体画作转为生产一种理念或风格(「绘」的含义可能也将变化),以这种风格(或理念)作为一件作品,而非由一幅或一系列具体画作隐含地界定出一种风格(或理念)。由此,人类的创作将转移到更抽象的层次。

1.3. 大型语言模型应用的企业部署 / Deploying LLM applications in enterprises

当前以 ChatGPT 为代表的 LLM 需要动用超级计算机的算力完成模型的训练和使用,其部署多为集中式的(使用已有 LLM 获得二次语料的模型可在小型计算机中部署)。但考虑到企业应用的保密要求,今后在政企用户中部署时很有可能必须做到模型的本地化和/或私有化。考虑到特定单位实际并不需要完全通用的模型,则很有可能使用此种架构:由超算保证通用模型的运转,各企业用户自建特化的模型插件,通过两者的结合实现企业用户的使用需求。

2. 消费品市场 / Consumer markets

2.1. 用技术定义的豪华 / Technology-defined luxury

自 2022 年 12 月起,比亚迪逐步发布了高端汽车品牌「仰望」的相关信息,并在 2023 年 4 月举办的上海车展向公众开放展示品牌旗下越野车 U8 和超级跑车 U9。期间发布的多段视频(原地掉头、轮胎失压、冰雪行驶、浮水脱困、沙漠冲顶等)展示了所搭载平台的卓越性能和强大实力,已开启预售的 U8 的价格亦在潜在用户群中出现了有如《镜花缘》君子国市场上务求增价的场面。

比亚迪在电动车领域通过技术积累和突破,似意图打破传统高端汽车领域由品牌认知产生的溢价,转而通过新技术的应用创造「新秩序」。

3. 人文与社会 / Culture & society

3.1. 承诺与当下 / Future promise vs current action

在一开始的宣传中,缴纳养老保险是为了将来获得养老金,但由于当下所缴实际用于支付当下的养老,则未来的兑付存在不确定性,而资金池的亏空也终于必然地出现了。于是,整个系统作出了一些调整,通过增加当下的投入来维持对未来的承诺。这种通过(对未来的)承诺获得(当前)利益的做法并不少见,期货交易即为其一。

这样的系统在实践中似乎必须加入能在当前获得收益的部分,仅有未来收益的系统几乎总是难以启动。而当一个系统中存在不对等的支出-收益比时,用于确保远期承诺兑现的标的物很容易在兑现期到来前被大量侵蚀,导致往往需要中途提出新的承诺来掩盖问题,债务展期即为其一。而监管却是必然存在漏洞的,且监管的响应总是滞后的。

亦有一种承诺是为了规避当下可能承担的任何责任,而将尽可能多的投入推给未来的其他人。山西泽州推出的二(三)孩中考加分等政策即为其一。

承诺属于信用的一种,而作为现代经济社会运转的基石,信用却是虚幻而脆弱的,它极易(或几乎一定会)被少数人或强力机构用来为自己谋利。人类社会若继续生存在「信用大厦」,这样的问题也将持续存在下去。

3.2. 人类的解放与奴役 / Liberation vs serfdom of human beings

ChatGPT 展示出的智能程度的突破引起了非技术领域的广泛讨论,从 AI 对人类工作岗位的替代引申到 AI 的发展对人类社会形态的影响。从当前 AI 产品的表现来看,其所能替代的仍以基础性的工作和部分低阶的创作型工作为主,其实是有利于将人从繁重的机械劳动中解脱出来的。即使在绘画领域,AI 工具所做的也是在覆盖人类对实体工具和数字工具的使用,而画作本身意图呈现的信息和思想(至少在今后一段时间内)仍需由人类主导。

而在短期受其冲击而「被释放」的生产力是会转化为高阶生产,还是被利用和消耗,已经是需要严肃思考的问题。当前不少互联网企业已经在(免费)利用广大用户的行为进行数据标注,而本就以「机械」劳动或「伪创作」劳动为生的人会在多大程度上被驱使进入只能为 AI 工作的境地?亦或者有很多人进入某些被间接催生出的工作岗位,如因短视频平台的出现而兴起的「生活表演」行业,是否会成为一种常态?

「学院派Academia」发布的视频「AI 会带来赛博朋克,还是解放全人类?」介绍了三种现有的理论思考,从人类社会的多个视角作了解读。「兔主席」(微信公众号:tuzhuxi)的系列文章「ChatGPT 的价值观及立场」(一、二、三、四)详细研究了 ChatGPT 产品在多个领域展现出的价值倾向并总结了其可能产生的影响,文章「从 GPT/AGI 到未来世界的政治」尝试讨论了 AI 对政治可能产生的影响,系列文章「GPT、科技、人类的生产、知识与未来」(上、下)展望了 AI 技术的进步可能对人类社会各方面产生的影响,文章「人工智能的釜底抽薪:对人类劳动价值的颠覆」探讨了本轮 AI 技术进步对生产要素的影响及其对策,文章「人类的“自问”:谁能够应对并驾驭未来世界?」从人类个体的视角提供了应对 AI 变革的若干措施,文章「适应未来世界的“法宝”——国际视角下的“共同富裕”(三)」展望了 AI 技术应用对形势与政策、社会形态等的影响。

3.3. 信息差的影响 / Impacts of information gap

由于 OpenAI 未向中国境内用户提供 ChatGPT 的使用,有不少「平台」通过声称或误导可提供相关服务来谋利,这可视为信息差带来经济利益的一则具体表现。

一般地,信息掌握程度的不同对人的选择有着重要影响,特别是在面临重大决定时,关键信息的缺失或筛选困难、对关键信息的无意识等会在较长时间内产生巨大影响。如高考填报志愿时对专业的选择显然是对人生轨迹具有重大影响的事件,无专业目标或对目标专业无有效认知将使自己在学习和工作中遇到层出不穷的困难;对就业无目标或不了解行业形态时,在求职和初入职场时也很容易碰壁;小到对于简历撰写和投递方面的不同认知,也会对就业机会产生不小的影响。因此,有必要提前展望将来会面临的局面及其中可预期的细节,并提前做好信息收集和必要的准备,尽量避免临时应对原本必然会遇到的场景。

Leave a Reply